探索硬件加速如何重塑计算性能与能效的未来格局

- 问答

- 2025-11-01 05:32:20

- 11

来源:综合行业分析与技术趋势观察

我们正处在一个数据爆炸的时代,手机、汽车、工厂、家居都在不停地产生海量数据,传统的通用处理器(CPU)就像一位知识渊博的“全能管家”,能处理各种任务,但面对一些非常特定、重复性极高且计算量巨大的任务时(比如高清视频处理、人工智能模型训练、复杂的科学计算),它就会变得效率低下、耗电惊人。

这时,“硬件加速”就登场了,它的核心思想非常简单:与其让“全能管家”事必躬亲,不如为特定的重活儿量身定制专用的“工具”。 这些专用“工具”就是各种硬件加速器,例如图形处理器(GPU)、神经网络处理器(NPU)、张量处理单元(TPU)等。

硬件加速如何提升性能?

- 专器专用,效率倍增:GPU最初是为处理电脑游戏中的大量图形像素而设计的,它的结构是成千上万个小核心同时工作,非常适合进行并行计算,当人们发现人工智能中的大量矩阵运算也是并行任务时,GPU就自然成为了训练AI模型的利器,其速度远超CPU。(来源:NVIDIA与AMD技术白皮书)

- 从软件到硬件的深度优化:更进一步的加速器,如NPU和TPU,是专门为AI算法从底层硬件层面设计的,它们去掉了通用计算中不必要的部分,将特定的计算步骤“固化”在芯片里,这就好比修建一条从A点到B点的直达高速公路,而不是让数据在CPU的“城市普通道路网”里绕来绕去,速度自然天差地别。(来源:Google关于TPU的学术论文)

硬件加速如何改善能效?

- 减少不必要的开销:通用CPU为了保持其“全能”性,内部结构非常复杂,需要大量晶体管和电路来管理任务调度、缓存等,这本身就会消耗很多能量,而专用加速器结构精简,目标单一,绝大部分能量都直接用在了“计算”这件正事上,避免了无谓的损耗。

- “事半功倍”的效果:由于专用加速器处理特定任务的效率极高,它可以在极短的时间内完成同样的任务,完成任务越快,芯片活跃的时间就越短,整体能耗也就显著降低,这对于手机续航、数据中心电费和环境可持续性都至关重要。(来源:IEEE能效计算研究报告)

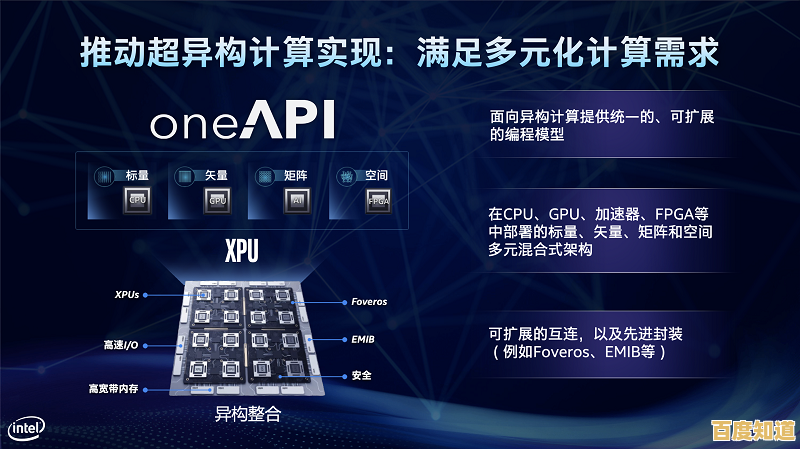

未来格局的重塑:从“通用计算”到“异构计算”

硬件加速正在将计算世界从“一刀切”的通用模式,推向一个“团队协作”的异构计算时代,未来的计算系统不再仅仅依赖一个强大的CPU,而是由一个CPU作为“总指挥”,协同多个不同类型的加速器(GPU、NPU、甚至更专用的芯片)组成一个“专家团队”。

- 消费电子:我们的手机芯片已经集成了NPU,用于高效处理拍照优化、语音助手等AI任务,在提升体验的同时极大节省了电量。

- 自动驾驶:自动驾驶汽车需要实时处理海量的传感器数据(摄像头、激光雷达等),做出毫秒级的决策,这必须依赖强大的专用AI芯片进行硬件加速,CPU根本无法独立胜任。(来源:特斯拉自动驾驶芯片技术披露)

- 科学研究和云计算:在药物研发、气候模拟、天体物理等领域,研究人员可以租用云服务商提供的搭载了成千上万个加速器芯片的计算集群,在几天内完成过去需要数年的计算工作。

挑战与展望

尽管前景广阔,硬件加速也面临挑战,为不同的加速器编写程序比为CPU编程更复杂,需要开发者学习新的工具和方法,如何让CPU、GPU、NPU等不同“专家”在系统中高效、无缝地协同工作,也是一个重要的技术课题。

硬件加速通过“把对的工具用在对的活儿上”这一朴素原理,正在从根本上突破通用计算的性能瓶颈和能效天花板,它不仅是让我们的手机更智能、电脑更快,更是在驱动人工智能、自动驾驶、元宇宙等未来科技浪潮的核心引擎,深刻重塑着整个数字世界的底层架构。

本文由务依丝于2025-11-01发表在笙亿网络策划,如有疑问,请联系我们。

本文链接:http://fengyu.xlisi.cn/wenda/68524.html